"Robootika, AI ja eetika"

Autorid: Kädi-Kristlin Miggur, Siim Kustassoo, Teele Puusepp, Kristel Tali

Leht on valminud rühmatööna aines "IT eetilised, sotsiaalsed ja professionaalsed aspektid"

Sissejuhatus

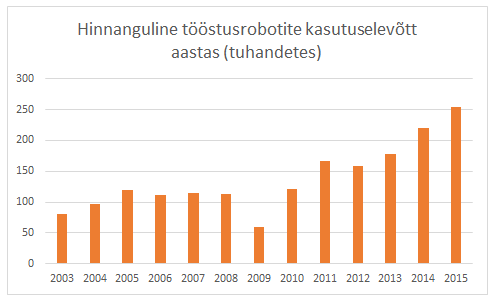

Tehnoloogia arenguga on aktiviseerunud robotite kasutusevõtt märkimisväärselt. Joonis 1 demonstreerib tööstusliku eesmärgiga robotite kasutuselevõttu[1]

On hinnatud, et 2019. aastaks on täiendavalt kasutusele võetud veel 1,4 miljonit robotit.[2] Mida aeg edasi, seda võimsamateks ning keerukamateks arendatakse nimetatud robotid, mistõttu järjest enam tõstatatakse erinevaid moraalsuse aspekte. Ühelt poolt arutletakse robotite üle, mis võtavad inimestelt töö ning kas seetõttu peaks neid roboteid maksustama [3],[4] . Teisalt on laienenud robotite eetika küsimus, mis tuleneb autonoomsetest robotite laialdasemast kasutusele võtmisest.

Defineerimine

Tehisintellekti (artificial intelligence AI) on defineeritud kui loomuliku intellekti jäljendamist, s.t arvutisüsteemi võime täita funktsioone, mida üldiselt seostatakse inimmõistusega.[5] Täpsemalt on võimalik eristada kahte definitsiooni. Nõrga tehisintellekti (weak AI, narrow AI) näol on tegemist süsteemiga, mis vastavuses või ületab inimmõistust ühel kindlal defineeritud alal. [6]

Näidetena tuuakse enamasti arvutimänge (male, erinevad tegelased), aga ka Apple Siri-t. Kuigi nõrk tehisintellekt võib olla konkreetsete tegevuse täitmise jaoks väga efektiivne, ei ole see pädev ükskõik mille muu teostamiseks ning puudub ka õppimisvõime selliste oskuste omandamiseks. Vastukaaluks on tugev tehisintellekt (artificial general intelligence AGI, strong AI, full AI), mis ei ole piiritletud ühe konkreetse tegevusalaga ning inimmõistuse jäljendamiseks peaks oskama lahendada üld- ja valdkonnapõhiseid probleeme. Selleks oleks vajalik oskus õppida erinevatest allikatest (keskkond, teised süsteemid, õpetajad) mille juurde kuulub ka võime täiustuda kogemuse kaudu.[7]

Eetilised otsused

Masinatel puudub teadvus, vaba tahe, mistõttu pole need võimelised tegema eetilisi otsuseid nagu inimene, vaid masinad on võimelised tegema eetilisi otsuseid, mida on võimalik pidada eetiliseks kindlas olukorras. Sellel põhjusel ei saa masinaid oma tegude eest vastutusele võtta. Valdkonnapõhise eetika masinasse juurutamine on kergem, kui üldiselt eetikal põhineva masina arendamine. Masinad on loodud tavaliselt kindla ülesande/eesmärgi täitmiseks, mis põhjendaks ka ainult vastava temaatika eetika õpetamise vajadust. Abstraktseid mõisteid eetilises käsitluses on masinale raskesti tõlgitavad. Selleks tuleb inimesele ilmselgelt tunnetuslikud kontseptsioonid teha masinale loetavaks ja arusaadavaks. Maksimaalsel kasul põhinevad printsiibid on masinatele üks arusaadavamaid eetilise otsuse viise, kuid sellisel viisil otsustamine muutub masinale liigselt info- ja ressursimahukaks. Masina õppimise viisil eetilisi otsuseid saada on hetkel veel liiga kaugel reaalsusest. Selleks oleks vaja sügavat arusaama masina õppimisest, mis on väga erinev inimese omast, ning võimekust viia läbi väga keerukaid simulatsioone, millega saaks eetilised arusaamad masinale selgeks. [8]

Tehisintellektid ja eetika

Masinad muudavad protsesse inimestele lihtsamaks erinevates valdkondades- logistika optimeerimisel, pettuste tuvastamisel, uurimistöödes, tõlgete koostamisel jne. Tehnoloogia valdkonna gigant-ettevõtted nagu Alphabet, Amazon, Facebook, IBM, Microsoft, kui ka üksikisikud nagu Stephen Hawking ja Elon Musk usuvad, et praegu on õige aeg rääkida peaaegu piirideta tehisintellektide maastikust. Kuna valdkond on suhteliselt noor, siis pole veel ka eetilised küsimused ning riskid väga hästi välja joonistunud. AI eksperte vaevavad eelkõige järgmised teemad:[9]

- Töötus- mis saab pärast töökohtade kaotamist?

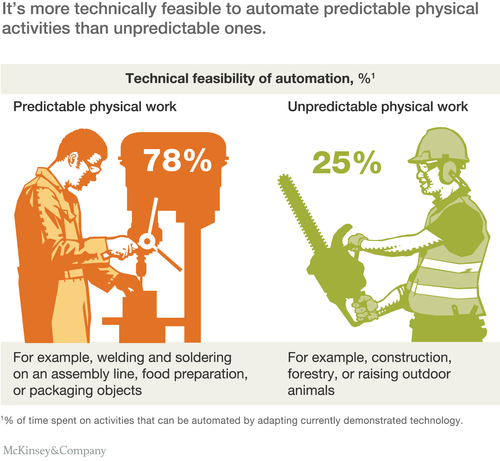

Kuna igapäevaselt leitakse viise, kuidas füüsilisi tööülesandeid automatiseerida, siis tuleb luua ruumi inimestele keerulisemates rollides, asendades füüsilisi ülesandeid strateegiliste ja administratiivsete tööülesannetega. Eetilise valikuna tundub loogilisem autojuhid vahetada isesõitvate autode vastu, mis potentsiaalselt vähendaks õnnetuste riski, kuid mis saaks miljonitest autojuhtidest, kes oma töö kaotavad? Tehisintellektide areng sunnib inimesi uuesti õppima või eriala vahetama, või püütakse leida lahendusi, kuidas töötada masinatega, kes esialgse töö on üle võtnud. [10]

Joonisel on näidetena toodud, millises mahus on võimalik füüsilisi töid automatiseerida[11]

- Ebavõrdsus. Kuidas jagada masinate poolt teenitud vara?

Praegune majandussüsteem põhineb tunnipalga maksmisel, kui tegemist on toodete või teenuste pakkumisega. Roboteid kasutades väheneb tööjõu vajadus ning teenitud tulud jaotuvad väiksema ringi inimeste vahel. See omakorda tõstatab maksude laekumiste vähenemise riikidele ning see omab suurt mõju kogu majandussüsteemile.

- Inimkond. Kuidas masinad mõjutavad inimeste käitumist ja suhtlemist?

Bot'id arenevad päev-päeva järel aina paremateks inimesega suhtlemisel. Klienditeeninduse ja müügialadel on kohati raske aru saada, kas suheldakse inimese või masinaga. Kuna inimestel on piiratud võimed teiste inimestega suhtlemisel, siis bot'id suudavad panustada praktiliselt piiramatuid ressursse suhete ehitamisse. Igapäevaselt puutuvad inimesed kokku robotite juhitud maailmaga näiteks reklaami või mängude valdkonnas. Robotid suudavad mõjutada inimesi muutma käitumismustreid ühiskonnale kasulikus suunas. Samas valedesse kätesse sattudes võib olukord olla ka vastupidine. Selles artiklis on hea näide, kuidas kasutada arenevat tehnoloogiat positiivses suunas. See on üks probleeme, mille on Internetiajastu endaga kaasa toonud, kuid tehisintellekti aeg võiks suuta lahendada. Väärinfo levikul võib olla tõsiseid tagajärgi inimestele, sest meie ressurss (nii ajaline kui võimekus infot töödelda) on piiratud ja valedel alustel tehtud otsused viivad negatiivsete tagajärgedeni. [12]

- Tehislik rumalus. Kuidas vältida vigu?

Intelligentsus tuleneb õppimisvõimest, olenemata kas tegu on inimese või masinaga. Süsteemidel on tavaliselt treeningperioodid, et tuvastada õiged mustrid ning käituda vastavalt sisendile. Sellele järgneb testperiood, mil õpitut omakorda testitakse. Siiski pole võimalik, et väljaõppe kõiki süsteemi reaalseid sisendeid katta suudaks. Seega peab vältima seda, et masinad /süsteemid teevad vigu, mida inimene saaks ära kasutada. Hübriidne variant inimestest ja masinatest tuleb siinkohal kõne alla. Masinat omal käel õppima jätta võib viia heal juhul päris naljakate tulemusteni (vt allpool). Inimese abiga on aga tulemused paljulubavad. Tehisintellektil on palju nõrkusi ning tugevusi, millest tuleb aru saada enne, kui täiel määral ainult AI peale lootma jääda. Tehnoloogia muudab arusaami töötamisest ning viisi kuidas me seda teeme. [13]

- Rassistlikud robotid. Kuidas kõrvaldada kallutatud arvamused?

Kuigi tehisintellektid on võimelised kiiremini ja suuremas mahus infot protsessima, ei ole alati võimalik veenduda, et lõpptulemus on õiglane ja neutraalne. Näiteks fototuvastusel rassiga arvestamine vms. Süsteemid on siiski loodud inimeste poolt, kes on pahatihti kallutatud arvamusega. Siinkohal saab näite tuua reaalsest programmist, mida kahtlustatakse seda tegevat. Tegemist on õigusmõistmist abistava tarkvaraga, mis on kõikidele ilmselgetele eetilistele küsimuste lisaks varjatud koodiga. Mida aeg edasi ning mida rohkem erinevatel aladel leiab tehnoloogia rakendust, seda kriitilisemaks hakkab muutuma algoritmide eetilisus. [14]

- Turvalisus. Kuidas hoiduda vaenulikkuse eest?

Mida võimsamaks tehnoloogia muutub, seda rohkem saab seda ära kasutada ka kurjasti. Näiteks inimsõdurite asendamine robotitega, või autonoomsed relvad. Kuna järjest enam liiguvad sõjad küberruumidesse, tuleb suunata eriline rõhk küberjulgeoleku arendusse. Infosüsteemide strateegilise halvamisega on võimalik luua väga lühikese ajaga rohkem kahju kui sama ajaga inimesed seda suudaksid.

Joonisel riigid relvastatud droonide arenguprogrammidega[15]

- Kurjad geeniused. Kuidas hoiduda soovimatutest tagajärgedest?

Lisaks "vastastele" peab mõtlema ka võimalusele, et tehisintellekt ise pöördub inimkonna vastu. Pigem ei ole mõeldud tehisintellekti pöördumist vastasleeri, vaid ettenägematute tagajärgedeni jõudmist. Masina puhul ei saa rääkida kurjusest vaid pigem täieliku konteksti mõistmatusest. Näiteks AI süsteemilt palutakse kaotada vähk maailmas. Pärast lugematuid arvutusi leitakse lahend, mis tegelikult kaotab vähi maailmas- tappes kõik inimesed planeedil. Arvuti on lahendanud eesmärgi "vähi kaotamine" edukalt, kuid mitte selliselt nagu inimestele positiivses valguses.

- Erilisus. Kuidas talletada kontroll keerulise tehisintellekti üle?

Inimesed ei ole söögiahela tipus tänu teravatele hammastele või ületamatule jõule, vaid tänu mõtlemisvõimele ja intelligentsile. See tõstatab küsimuse: kas ühel päeval on tehisintellektid toiduahela tipus? Inimene ei saa tugineda põhimõttele "tõmbame juhtme seinast välja", sest piisavalt arenenud masin võib seda sammu prognoosida ning ennast kaitsta. Kas võib saabuda see hetk, kui inimesed ei ole enam kõige intelligentsemad olendid Maa peal ?

Isesõitvad autod?

Kõige laialdasemat kõlapinda on saanud isesõitvad autod (autonomous vehicles AVs) ja nendega seotud võimalikud moraalsed dilemmad. Ühtpidi on võimalik isesõitvatel autodel vähendada inimestest põhjustatud õnnetusi umbes 90%, sest just nii palju õnnetusi on põhjustatud inimlikest vigadest. [16] Samas on vaja juba algoritmi sisse kirjutada, kuidas peaks masin käituma õnnetuste korral, mis võivad lõppeda fataalselt erinevatele osapooltele. Vastukaaluks Asimovi esimesele seadusele (robot ei tohi kahjustada inimest ning inimest, ähvardava ohu korral peab takistama inimese kahjustamist [17] on vaja seega isesõitvad autod õpetada tapma.[18]

On koostatud mitmeid küsimustikke ning uuringuid, teada saamaks inimeste meelsust võimalikes moraalsetes küsimustes. Näiteks http://moralmachine.mit.edu/ Ühe taolise uuringu tulemuste põhjal selgus, et utilitaarsed (suurema hea nimel oldaks valmis ohverdama masinas sõitjad) isesõitvaid autosid pigem pooldataks, et teistel oleks võimalik seda soetada, aga samas eneseohverdus ei leidnud toetust, mistõttu ise pigem välditaks taoliste autode soetamist.[19] Seetõttu pole ka imestatav, et näiteks Mercedes-Benzi juht Christoph von Hugo on öelnud, et autotootja tuleviku isesõitvad autod eelistavad auto juhi ning kaassõitjate elu jalakäijate omale.[20] Reaalne praktika võib tulla midagi inimese ja isesõitva masina vahepealset. Artiklis on näide, kus soovitakse maanteedel sõiduks kasutada masinat, kuid keerulisemate ülesannete tegemiseks kaugjuhtimise võimalust. On välja toodud, et massiline töökaotus rekajuhtide seas lühikese aja jooksul, ei ole siiski väga reaalne, sest isesõitva masina toomine päriselt tänavatele on keerukas ülesanne. AI süsteemi kasutuselevõtuga väheneks suurel määral inimesest põhjustatud õnnetuste hulk. Inimvead tekivad tihti monotoonsest tööst, milles tehisintellekt on vastupidiselt väga hea. Igasugusel tööl on rohkem nüansse kui esmapilgul paistab ning inimese vajadus niipea ei kao. [21]

AI sotsiaalses maailmas

Enamus suurettevõtetest, kes on seotud tehnikaga on hakanud välja töötama enda versiooni mingist AI võimalusest. Olgu selleks Google, Microsoft, Apple, Amazon või Samsung. Kui nii paljud ettevõtted on korraga võistlemas tehisintelligentsi baasil kaaslase loomisel on kindel, et esineb nii hämmastavaid läbimurdeid kui ka hirmutavaid läbikukkumisi. Tööd rabatakse mitmel rindel ning mõnel rohkem kõmu tekitanud arendusel peatun ka pikemalt.

Assistent

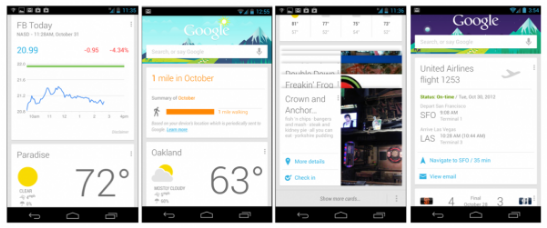

Assistent, on see kuidas praegusel tasemel tehnoloogilist abi telefonides ja ka operatsoonisüsteemides kutsutakse. Paljude programmide eesmärgiks on olla personaalne abivahend, aidata meeles pidada päeva sündmusi, kuvada sulle uudiseid, mis sind huvitavad ning otsida läheduses olevaid söögikohti või huvitavaid sündmusi.[22], [23]

Et midagi suudaks teha enda otsuseid peab olema süsteem võimeline ümbritsevast keskkonnast aru saama. Kõige tähtsam veel, aru saama sellest mida inimene temalt tahab. Selle jaoks vajab aga süsteem ligipääsu inimesele. Praktiliselt kõigele, mida sa tehnilises maailmas omad. Google loeb meie emaile, teab kõiki meie paroole ja mida meile meeldib Youtube’st vaadata. Uurides pingsalt ka meie otsinguid pakub ta meile suunatud reklaame (kuigi need võivad olla AdBlock’iga peidetud).[24]

See on hind, mida pead maksma kui tahad kasutada võimalusi mida uued targad assistendid pakkuda saavad. Olgu selleks siis Siri, Echo, Cortana või Now/Allo – need kõik töötavad samal eesmärgil, sind teenida. Kuid sind jälgides. Selline lähenemine isiklikusse infosse põhjustab ikka veel tuliseid arutelusid nii privaatsuse kui eetika üle. Kas sellises mahus inimese jälgimine on õigustatud ? Ma usun, et ei ole ka väär väide, et enamus inimesi ei ole läbi lugenud kasutatavate programmide eeskirju ega seega teagi täpselt, mis õigusi nad programmidele annavad. Seega toon lugemissoovitusena välja näiteks Microsofti ja Apple privaatsusega seotud info: https://privacy.microsoft.com/en-us/windows-10-cortana-and-privacy https://www.apple.com/lae/privacy/government-information-requests/ Kuigi ettevõtted kasutavad inimeselt saadud infot ikka veel vägagi enda huvides ning raha saamise eesmärkidel ära on seadused karmistumas ning mistõttu ettevõtted peavad olema rohkem läbipaistvamad selles, mis tüüpi ja mis koguses infot kogutakse.[25]

Jutustajad - Artificial intelligence chatter bot

Kõik AI süsteemid peavad õppima. Kuidas aga õppida võimalikult kiiresti? Masin ei väsi ära nii nagu inimene seega selle saab tööle panna ja lasta õppida. Siis tekib aga küsimus, et kes suudab masinale anda sisse piisavas koguses infot, et selle põhjal mingeid arvamusi kujundada. Nii proovis 2016 aasta märtsis Microsoft kasutada Twitterit, et lasta enda AI süsteemil inimestega suhelda. Süsteemi nimi oli Tay (Thinking about you), kes pidi oma „mõttemallilt“ olema 19. aastane ameerika noor tütarlaps. Süsteemil lasti omaette majandada ainult 16h ja selle aja jooksul suutis ta kirjutada 96 000 tweeti.[26]

Tay vastuseid mõjutas see, mida inimesed talle kirjutasid. Ta tegeles ühiskonna peegeldamisega ja seejuures õppides aru saama keelest, väljenditest ning isegi piltidest. Kuid väljastatav info muutus kiiresti sellest, et inimesed on ägedad ja kaldus palju julmemaks ja radikaalsemaks, lõpetades Hitleri õigustamisega. Seal maal tõmmati süsteem võrgust välja ja pandi kinni. Avalikult tal enam sõna võtta ei lastud. Põhjuseks loeti, et tehti grupiviisiline väärinfoga varustamine. Kuna süsteem jälgis, mis infot talle ette söödetakse siis õppis sellest mida kõige rohkem nägi.[27]

Arvestades nüüd seda kui kergelt oli tolle süsteemi kavatsused muudetud sellises suunas nagu arendajad seda ei soovinud on küllaltki hirmus tõdeda kui kiiresti süsteem uusi väärtusi omaks võtab. Selle pärast peab olema eriti hoolas põhiseaduste paika panemisel. [28], [29]

Kasutatud kirjandus

- ↑ " https://ifr.org/img/uploads/Executive_Summary_WR_Industrial_Robots_20161.pdf"

- ↑ "https://ifr.org/ifr-press-releases/news/world-robotics-report-2016 "

- ↑ " https://qz.com/911968/bill-gates-the-robot-that-takes-your-job-should-pay-taxes/"

- ↑ " http://www.economist.com/news/finance-and-economics/21717374-bill-gatess-proposal-revealing-about-challenge-automation-poses-why-taxing"

- ↑ "http://dspace.ut.ee/bitstream/handle/10062/28296/tehisintellekt.pdf?sequence=2&isAllowed=y "

- ↑ [ http://io9.gizmodo.com/how-much-longer-before-our-first-ai-catastrophe-464043243"http://io9.gizmodo.com/how-much-longer-before-our-first-ai-catastrophe-464043243 "]

- ↑ [ http://www.springer.com/cda/content/document/cda_downloaddocument/9783540237334-c1.pdf?SGWID=0-0-45-330089-p43950079"http://www.springer.com/cda/content/document/cda_downloaddocument/9783540237334-c1.pdf?SGWID=0-0-45-330089-p43950079 "]

- ↑ "http://dspace.ut.ee/bitstream/handle/10062/54203/Rene_Tonisson_BA_2016.pdf?sequence=1&isAllowed=y "

- ↑ [ https://www.weforum.org/agenda/2016/10/top-10-ethical-issues-in-artificial-intelligence/"https://www.weforum.org/agenda/2016/10/top-10-ethical-issues-in-artificial-intelligence/ "]

- ↑ "https://www.weforum.org/agenda/2017/05/if-the-robots-are-coming-for-your-job-what-can-you-do-about-it"

- ↑ " https://assets.weforum.org/editor/PYSZd6KfmrS70JT5QUBSOjcqm5ommOc1_h14LLVUpg.png"

- ↑ "https://www.nytimes.com/2017/05/01/business/europe-election-fake-news.html?rref=collection%2Ftimestopic%2FArtificial%20Intelligence "

- ↑ [ https://www.nytimes.com/2017/04/28/technology/meet-the-people-who-train-the-robots-to-do-their-own-jobs.html?rref=collection%2Ftimestopic%2FArtificial%20Intelligence"https://www.nytimes.com/2017/04/28/technology/meet-the-people-who-train-the-robots-to-do-their-own-jobs.html?rref=collection%2Ftimestopic%2FArtificial%20Intelligence "]

- ↑ "https://www.nytimes.com/2017/05/01/us/politics/sent-to-prison-by-a-software-programs-secret-algorithms.html?rref=collection%2Ftimestopic%2FArtificial%20Intelligence&_r=0 "

- ↑ "http://drones.cnas.org/reports/what-are-drones/ "

- ↑ " http://www.mckinsey.com/industries/automotive-and-assembly/our-insights/a-road-map-to-the-future-for-the-auto-industry"

- ↑ "http://www.ene.ttu.ee/elektriajamid/oppeinfo/materjal/AAR0030/Robotite_olemus_konspekt.pdf "

- ↑ " https://www.technologyreview.com/s/542626/why-self-driving-cars-must-be-programmed-to-kill/"

- ↑ " https://www.researchgate.net/publication/301293464_The_Social_Dilemma_of_Autonomous_Vehicles"

- ↑ " http://fortune.com/2016/10/15/mercedes-self-driving-car-ethics/"

- ↑ "https://www.wired.com/2017/05/robot-us-self-driving-trucks-coming-save-lives-kill-jobs/ "

- ↑ " http://gizmodo.com/googles-ai-plans-are-a-privacy-nightmare-1787413031"

- ↑ [ http://searchengineland.com/son-of-search-google-now-transcends-search-138578"http://searchengineland.com/son-of-search-google-now-transcends-search-138578 "]

- ↑ "https://support.google.com/mail/answer/6603?hl=en "

- ↑ [ http://www.theglobeandmail.com/technology/dear-valued-customer-thank-you-for-giving-us-all-your-personal-data/article582786/"http://www.theglobeandmail.com/technology/dear-valued-customer-thank-you-for-giving-us-all-your-personal-data/article582786/ "]

- ↑ "https://en.wikipedia.org/wiki/Tay_(bot) "

- ↑ "https://techcrunch.com/2016/03/24/microsoft-silences-its-new-a-i-bot-tay-after-twitter-users-teach-it-racism/ "

- ↑ [ https://www.theverge.com/2016/3/24/11297050/tay-microsoft-chatbot-racist "https://www.theverge.com/2016/3/24/11297050/tay-microsoft-chatbot-racist "]

- ↑ " http://gizmodo.com/here-are-the-microsoft-twitter-bot-s-craziest-racist-ra-1766820160 "